$PHA / #PHA - 多头按照我的计划进行 https://t.co/hSqUAnbGdl

$PHA / #PHA - 多头按照我的计划进行 https://t.co/hSqUAnbGdl

认识来自 Phala Cloud 的 @bgmshana。

在最近一次关于保密计算系列的专题演讲中,他详细阐述了如何利用可信执行环境(TEEs)构建“隐私优先”的 AI 未来。🛡️🤖

以下是他会议的关键要点。🧵👇 https://t.co/ym34Eve40I

1/9🧵 AI 信任问题。

如今,当我们使用 AI 时,面临巨大的“信任问题”。云服务提供商和模型所有者(如 OpenAI 或 Azure)在技术上可以访问服务器内存,看到你的私人输入和模型的输出明文。

2/9🧵 引入 TEEs:“魔法黑盒”。

可信执行环境(TEE)是一种特殊的硬件模式,用于隔离工作负载。它充当一个黑盒,AI 推理在其中安全运行:云提供商和模型提供商都无法“窥视”。

3/9🧵 硬件演进。

TEEs 并非全新技术,但已发展。

- 2015:Intel SGX(仅限小代码)。

- 2022:NVIDIA GPU(Hopper)现在支持 TEEs,使我们能够在完全隐私的情况下运行庞大的大型语言模型(LLMs)。

4/9🧵 最小性能折衷。

人们可能认为隐私会降低速度,但开销出奇地低,通常在 1% 到 5% 之间,具体取决于工作负载。这使其在生产级 AI 中可行。

5/9🧵 远程证明。

如何确认它真正安全?TEEs 生成“远程证明”(Remote Attestation),这是一种来自硬件本身的加密证明。用户可以验证该证明,以确保精确、未被修改的代码在安全环境中运行。

https://t.co/8oWebbkJsC https://t.co/5PS8vefV42

6/9🧵 “完整信任链”。

真正的隐私需要保护每一层:

- 应用程序(开源/来源可追溯)。

- 端到端加密通信。

- 操作系统。

- TEE 硬件(CPU/GPU)。

https://t.co/zieDTKSTnp

7/9🧵 简化开发者体验。

过去将代码迁移到 TEEs 需要数月时间。现在,像 dstack 或 Phala Cloud 这样的工具让开发者可以在几分钟内以“一键”方式部署未修改的容器。

https://t.co/ExmPRY0PJQ

9/9🧵 总结:通过将 TEE 硬件与强大的软件证明相结合,@PhalaNetwork 终于可以解决 AI 的信任问题,实现私有代理和安全推理,而不牺牲性能。

https://t.co/GsGvltzIS6

8/9🧵 未来:碎片化 vs. 标准化。

生态系统目前呈碎片化状态(Intel TDX、AMD SEV、NVIDIA 等)。像 @redpill_gpt 这样的项目充当聚合器,提供统一的 API,使“保密 AI”像其他 AI 服务一样易于使用。

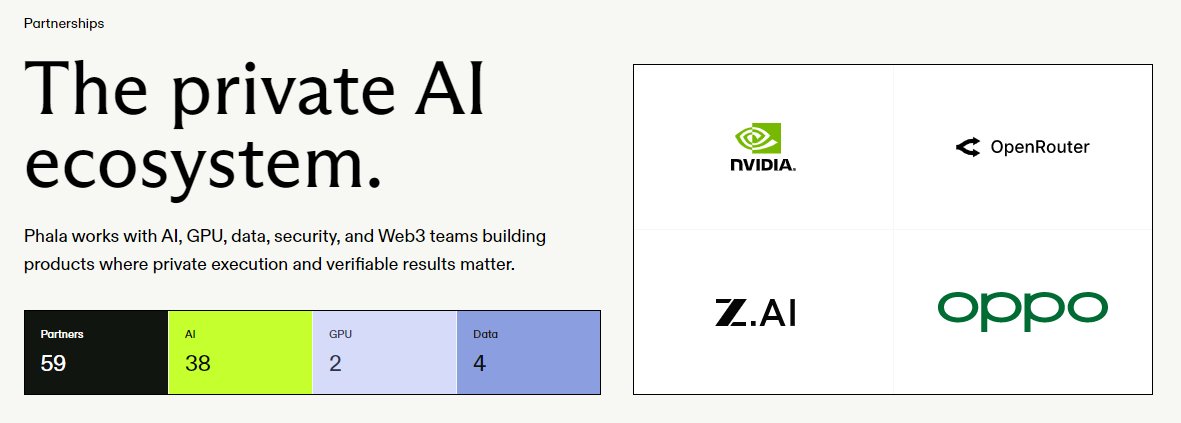

@PhalaNetwork 围绕机密 AI 所构建的内容真的被严重低估了。

Intel、ionet、NEAR AI、Hyperbolic、OpenRouter、Nous Research……甚至 OPPO 正在探索该领域。👀

这不是 hype(炒作)合作伙伴,而是围绕可验证且隐私保护的 AI 基础设施形成的真实生态系统。🔒☁️ https://t.co/zCdm5yaf3M

点击此链接查看合作伙伴列表:https://t.co/9NpdpfVhPX