$PHA / #PHA - 롱은 내 계획에 따라 진행됩니다 https://t.co/hSqUAnbGdl

$PHA / #PHA - 롱은 내 계획에 따라 진행됩니다 https://t.co/hSqUAnbGdl

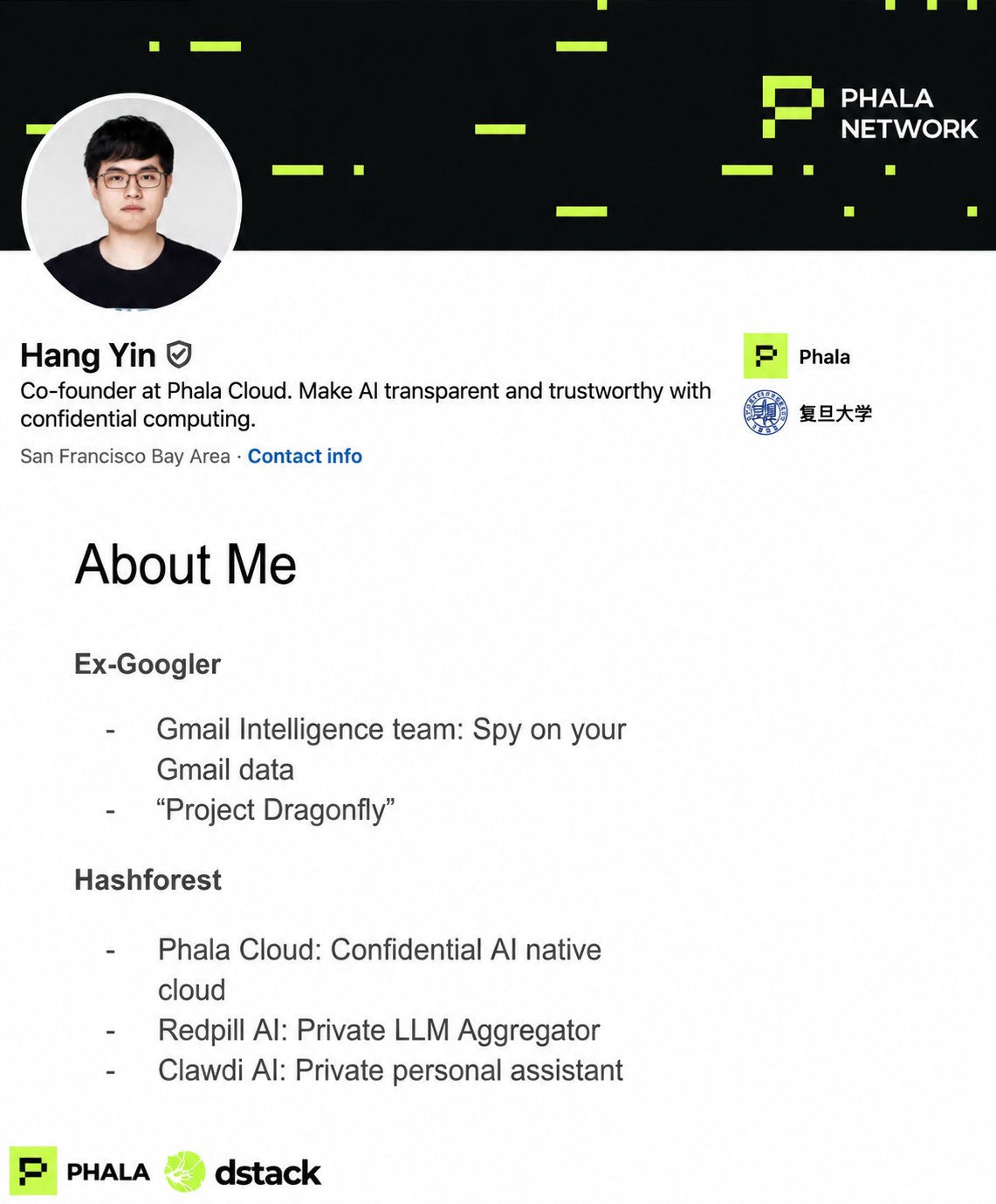

Phala Cloud의 @bgmshana를 만나보세요.

Confidential Computing 시리즈의 최근 특강에서 그는 Trusted Execution Environments (TEEs)를 사용해 AI의 "프라이버시 우선" 미래를 구축하는 방법을 설명합니다. 🛡️🤖

그 세션의 주요 요점은 다음과 같습니다. 🧵👇 https://t.co/ym34Eve40I

1/9🧵 AI 신뢰 문제.

오늘날 AI를 사용할 때 우리는 거대한 "신뢰 문제"에 직면합니다. 클라우드 제공업체와 모델 소유자(예: OpenAI 또는 Azure)는 기술적으로 서버 메모리에 접근해 개인 입력과 모델 출력의 평문을 볼 수 있습니다.

2/9🧵 TEEs 도입: "마법의 블랙 박스".

Trusted Execution Environment (TEE)는 워크로드를 격리하는 특수 하드웨어 모드입니다. AI 추론이 안전하게 실행되는 블랙 박스로, 클라우드 제공업체도 모델 제공업체도 내부를 "엿볼" 수 없습니다.

3/9🧵 하드웨어 진화.

TEEs는 새로운 기술은 아니지만 진화해왔습니다.

- 2015: Intel SGX (소규모 코드만 지원).

- 2022: NVIDIA GPU (Hopper)에서 TEEs를 지원하게 되어, 완전한 프라이버시로 대규모 대형 언어 모델(LLMs)을 실행할 수 있게 되었습니다.

4/9🧵 최소 성능 트레이드오프.

프라이버시 때문에 속도가 느려질 것이라고 생각할 수 있지만, 오버헤드는 놀라울 정도로 낮으며 작업에 따라 보통 1%에서 5% 사이입니다. 이는 프로덕션 수준 AI에 적용 가능하게 합니다.

5/9🧵 원격 증명.

실제로 안전한지 어떻게 알 수 있을까요? TEEs는 하드웨어 자체에서 생성된 암호화 증명인 "Remote Attestation"을 제공합니다. 사용자는 이 증명을 검증하여 정확하고 수정되지 않은 코드가 안전한 환경에서 실행되고 있는지 확인할 수 있습니다.

https://t.co/8oWebbkJsC https://t.co/5PS8vefV42

6/9🧵 "전체 신뢰 체인".

진정한 프라이버시를 위해서는 모든 계층을 보호해야 합니다:

- 애플리케이션 (오픈소스/출처).

- 종단 간 암호화 통신.

- 운영 체제.

- TEE 하드웨어 (CPU/GPU).

https://t.co/zieDTKSTnp

7/9🧵 개발자 경험 단순화.

예전에는 코드를 TEEs에 이식하는 데 몇 달이 걸렸습니다. 이제 dstack이나 Phala Cloud와 같은 도구를 사용하면 개발자는 몇 분 안에 수정되지 않은 컨테이너를 "원클릭"으로 배포할 수 있습니다.

https://t.co/ExmPRY0PJQ

9/9🧵 요약: TEE 하드웨어와 견고한 소프트웨어 증명을 결합함으로써 @PhalaNetwork는 AI 신뢰 문제를 최종적으로 해결하고, 성능을 희생하지 않으면서 개인 에이전트와 안전한 추론을 가능하게 합니다.

https://t.co/GsGvltzIS6

8/9🧵 미래: 파편화 vs. 표준.

현재 생태계는 Intel TDX, AMD SEV, NVIDIA 등으로 파편화되어 있습니다. @redpill_gpt와 같은 프로젝트는 통합 API를 제공하는 집계자로서, "Confidential AI"를 다른 AI 서비스처럼 쉽게 사용할 수 있게 합니다.

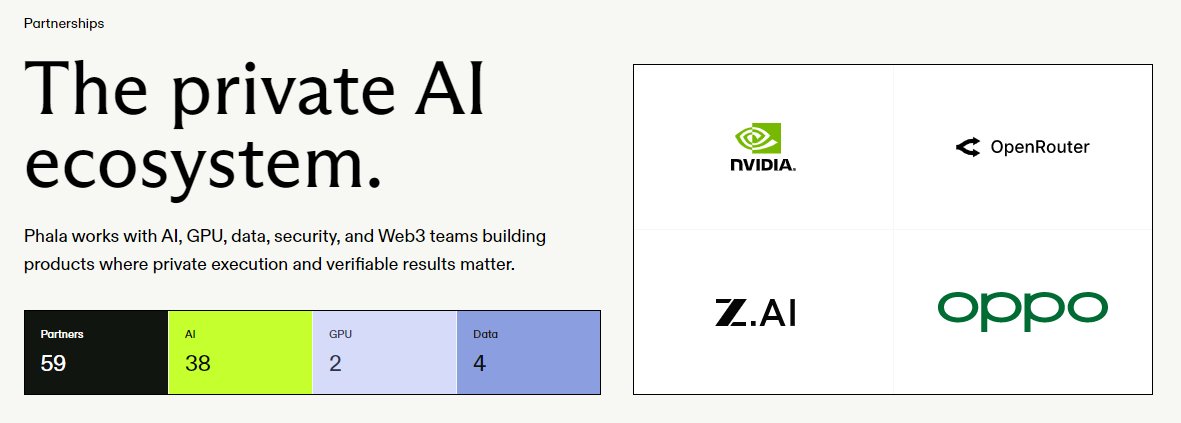

@PhalaNetwork가 기밀 AI 주변에 구축하고 있는 것이 심각하게 과소평가되고 있습니다.

Intel, ionet, NEAR AI, Hyperbolic, OpenRouter, Nous Research… 심지어 OPPO도 이 분야를 탐색하고 있습니다. 👀

과장된 파트너십이 아니라, 검증 가능하고 프라이버시를 보호하는 AI 인프라를 중심으로 실제 생태계가 형성되고 있습니다. 🔒☁️ https://t.co/zCdm5yaf3M

다음 링크를 클릭하여 파트너십 목록을 확인하세요: https://t.co/9NpdpfVhPX